1 藏久棋规则简述

2 融合先验知识的MCTS优化算法

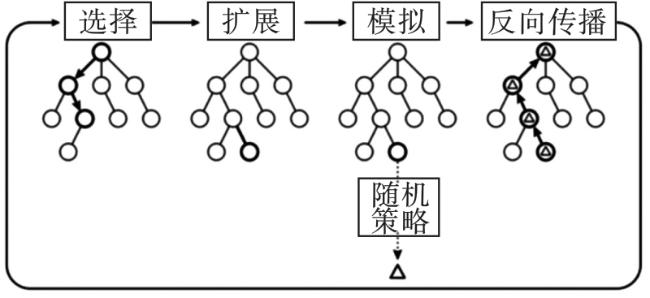

2.1 MCTS算法

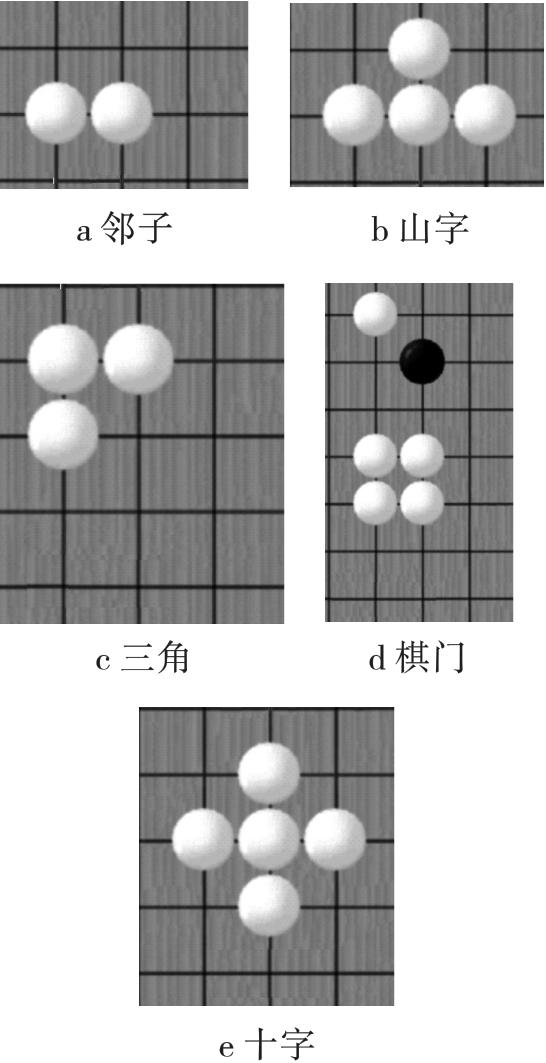

2.2 先验知识

表1 基础棋型及其价值(布局阶段) (w) |

| 棋型 | 价值 | |

|---|---|---|

| 激进 | 保守 | |

| 邻子 | N×4 | N×4 |

| 三角 | N×15 | N×20 |

| 山字 | N×10 | N×15 |

| 十字 | N×10 | N×10 |

| 棋门 | N×(-5) | N×5 |

|

表2 棋型价值(战斗阶段) (w) |

| 棋型 | 价值 |

|---|---|

| 邻子 | 2 |

| 三角 | 5 |

| 棋门 | 20 |

| 十字 | 15 |

| 褡裢 | 100 |

2.3 策略选择优化设计

end for

end function

2.4 融合先验知识

3 深度神经网络模型的训练

3.1 神经网络模型结构

3.2 训练数据

3.3 训练原理

3.4 损失函数

4 实验结果与分析

4.1 实验设计

表3 算法类型概述 |

| 类型 | 概述 |

|---|---|

| 算法1 | 传统的MCTS算法 |

| 算法2 | 基于神经网络的传统MCTS算法 |

| 算法3 | 优化的MCTS算法,使用融合先验知识的评估函数前未进行策略选择优化 |

| 本文算法 | 优化的MCTS算法,在进行策略选择优化后,使用融合先验知识的评估函数 |

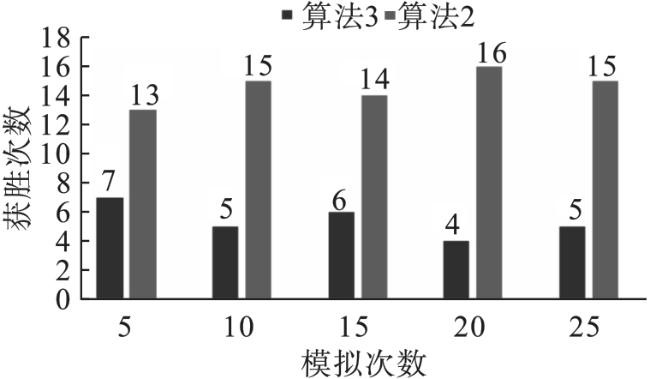

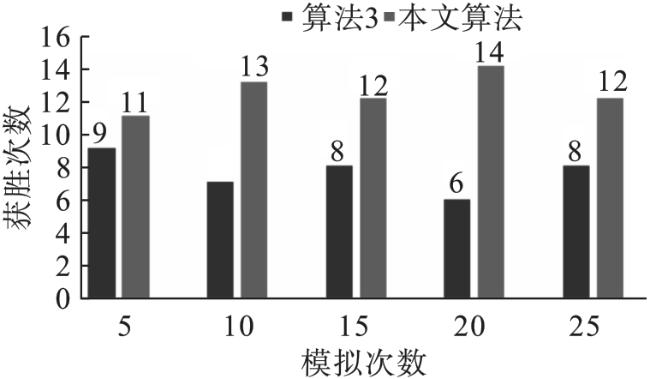

4.2 算法性能对比

表4 不同算法对弈结果 |

| 对弈双方名称 | 对弈结果[胜,负] | 获胜率/% |

|---|---|---|

| 本文算法 vs 算法1 | [171,19] | 90 |

| 本文算法 vs 算法2 | [135,45] | 75 |

| 本文算法 vs 算法3 | [123,57] | 68 |